ЪзДЮВПЪ№гЂЬиЖћMaxЯЕСаGPUЃЌМЋЙтГЌЫуНЋЭЦЖЏШЫЙЄжЧФмЪЕЯжЭЛЦЦадНјеЙ

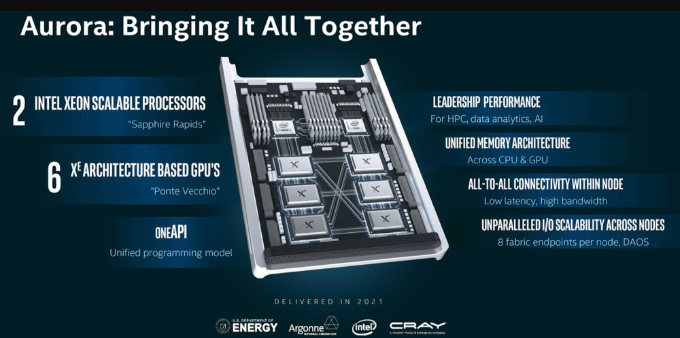

АЂЙБЙњМвЪЕбщЪвКЭгЂЬиЖћгкНќШеаћВМЃЌAuroraГЌМЖМЦЫуЛњЕФ 10,624 ИіЕЖЦЌЕФАВзАвбОЭъГЩЃЌИУЯЕЭГНЋгк 2023 ФъЭэаЉЪБКђЩЯЯпЁЃИУЛњЦїЪЙгУЪ§ЭђИі Xeon Max“Sapphire Rapids”ДІРэЦїЃЌХфБИ HBM2E ФкДцвдМАЪ§вдЭђМЦЕФЪ§ОнжааФ GPU Max“Ponte Vecchio”МЦЫу GPU ПЩЪЕЯжГЌЙ§ 2 FP64 ExaFLOPS ЕФадФмЁЃ

етИігЩHPE жЦдьЕФ Aurora ГЌМЖМЦЫуЛњгЩ 166 ИіЛњМмзщГЩЃЌУПИіЛњМмга 64 ИіЕЖЦЌЃЌзмЙВ 10,624 ИіЕЖЦЌЁЃУПИі Aurora ЕЖЦЌОљЛљгкСНИі Xeon Max CPUЃЈОпга 64 GB ЗтзА HBM2E ФкДцЃЉвдМАСљИі Intel Data Center Max“Ponte Vecchio”МЦЫу GPUЁЃетаЉ CPU КЭ GPU НЋЭЈЙ§ЖЈжЦЕФвКЬхРфШДЯЕЭГНјааРфШДЁЃ

ЃЈЭМЦЌРДдДЃКгЂЬиЖћЃЉ

Aurora ГЌМЖМЦЫуЛњзмЙВХфБИСЫ 21,248 ИіЭЈгУ CPUЃЌгЕгаГЌЙ§ 110 ЭђИіИпадФмКЫаФЁЂ19.9 PB ЕФ DDR5 ФкДцЁЂСЌНгЕН CPU ЕФ 1.36 PB HBM2E ФкДцвдМА 63,744 ИізЈЮЊДѓЙцФЃВЂаа AI КЭ HPC ЙЄзїИКдиЖјЩшМЦЕФМЦЫу GPUЃЌАхди 8.16 PB HBM2E ФкДцЁЃетаЉЕЖЦЌЪЙгУзЈЮЊГЌМЖМЦЫуЛњЩшМЦЕФ HPE Slingshot НсЙЙНјааЛЅСЌЁЃ

гЂЬиЖћЙЋЫОИБзмВУМцГЌМЖМЦЫуЪТвЕВПзмОРэ Jeff McVeigh БэЪОЃК“Aurora ЪЧгЂЬиЖћ Max ЯЕСа GPU ЕФЪзДЮВПЪ№ЁЂзюДѓЕФЛљгк Xeon Max CPU ЕФЯЕЭГвдМАШЋЧђзюДѓЕФ GPU МЏШКЁЃ” “ЮвУЧКмздКРФмЙЛГЩЮЊетИіРњЪЗадЯЕЭГЕФвЛВПЗжЃЌВЂЖд Aurora НЋЪЕЯжЕФЭЛЦЦадШЫЙЄжЧФмЁЂПЦбЇКЭЙЄГЬИаЕНаЫЗмЁЃ”

AuroraГЌМЖМЦЫуЛњВЩгУгЩ1024ИіЙЬЬЌДцДЂЩшБИзщГЩЕФДцДЂНкЕуеѓСаЃЌЬсЙЉ220PBЕФШнСПвдМА31TB/sЕФзмДјПэЃЌетНЋгажњгкДІРэЩцМАКЃСПЪ§ОнМЏЕФЙЄзїИКдиЃЌР§ШчКЫОлБфбаОПЁЂПЦбЇЙЄГЬЁЂЮяРэФЃФтЁЂжЮСЦбаОПЁЂЬьЦјдЄБЈКЭЦфЫћШЮЮёЁЃ

ЃЈЭМЦЌРДдДЃКАЂЙБЙњМвЪЕбщЪвЃЉ

ЫфШЛ Aurora ЕЖЦЌЕФАВзАвбОЭъГЩЃЌЕЋГЌМЖМЦЫуЛњЩаЮДЭЈЙ§бщЪеВтЪдЁЃЕБЫќдкНёФъЭэаЉЪБКђЩЯЯпЪБЃЌЫќгаЭћДяЕНГЌЙ§ 2 ExaFLOPS ЕФРэТлЗхжЕадФмЃЌЪЙЦфГЩЮЊНјШы Top500 СаБэЪБЕквЛЬЈДяЕНетвЛадФмЫЎЦНЕФГЌМЖМЦЫуЛњЁЃ

АЂЙБЙњМвЪЕбщЪвИБЪЕбщЪвжїШЮ Rick Stevens БэЪОЃК“дкЮвУЧХЌСІНјаабщЪеВтЪдЕФЭЌЪБЃЌЮвУЧНЋЪЙгУ Aurora РДбЕСЗвЛаЉДѓЙцФЃЕФПЊдДЩњГЩШЫЙЄжЧФмФЃаЭгУгкПЦбЇЁЃ” “Aurora гЕгаГЌЙ§ 60,000 Иі Intel Max GPUЁЂЗЧГЃПьЕФ I/O ЯЕЭГКЭШЋЙЬЬЌДѓШнСПДцДЂЯЕЭГЃЌЪЧбЕСЗетаЉФЃаЭЕФЭъУРЛЗОГЁЃ”

ЃЈЭМЦЌРДдДЃКАЂЙБЙњМвЪЕбщЪвЃЉ

ЫфШЛ Aurora ГЌМЖМЦЫуЛњЩаЮДЭЈЙ§ВтЪдЃЌANL ЩаЮДЯђ Top500.org ЬсНЛЦфадФмНсЙћЃЌЕЋгЂЬиЖћНшДЫЛњЛсЗжЯэСЫЦфгВМўЯрЖдгк AMD КЭ Nvidia ЕФОКељНтОіЗНАИЕФадФмгХЪЦЁЃ

ОнгЂЬиЖћГЦЃЌMax ЯЕСа GPU ЕФГѕВНВтЪдБэУїЃЌЫќУЧдк“ЯжЪЕЪРНчЕФПЦбЇКЭЙЄГЬЙЄзїИКди”ЗНУцБэЯжГіЩЋЃЌдк OpenMC ЩЯЬсЙЉЕФадФмЪЧ AMD Instinct MI250X GPU ЕФСНБЖЃЌВЂЧвМИКѕПЩвдЭъУРЕиПчЪ§АйИіНкЕуНјааРЉеЙЁЃДЫЭтЃЌгЂЬиЖћБэЪОЃЌЦфгЂЬиЖћжСЧП Max ЯЕСа CPU дкжкЖрЪЕМЪ HPC гІгУжаБШОКељЖдЪжЕФадФмгХЪЦИпГі 40%ЃЌетаЉгІгУАќРЈ HPCGЁЂNEMO-GYREЁЂAnerlastic Wave PropagationЁЂBlackScholes КЭ OpenFOAMЁЃ

РДдДЃКвЕНчЙЉИх

КУЮФеТЃЌашвЊФуЕФЙФРј

УзРЁЄФТРЬсжиЗЕЙЋжкЪгвАЃЌНїЩїЗЂЩљ

ФТРЕйЪБИє18ИідТЪзДЮНгЪмжиДѓУНЬхВЩЗУЃЌНщЩмЦфДДСЂЕФThinking Machines Labе§дкПЊЗЂЕФ"НЛЛЅФЃаЭ"ЁЃИУФЃаЭФмвд200КСУыМфИєДІРэвєЦЕЁЂЮФБОКЭЪгЦЕСїЃЌВЖзНШЫРрНЛСїжаЕФжаЖЯЁЂаое§КЭЭЃЖйЁЃЫ§ЛЙЬИМАOpenAI"еўБфжм"ОРњЃЌЧПЕїаавЕОіВпШЈЙ§гкМЏжаЕФЕЃгЧЃЌВЂЛигІСЫЙЋЫОНќЦкбаОПШЫдБРыжАЮЪЬтЃЌБэЪОетЪЧГѕДДЪЕбщЪвЕФе§ГЃВЈЖЏЁЃ

ЕБAIЛњЦїШЫЁАздаХЕиЁАзВЯђЧНБкЃКSTATE16баОПдКНвЪОЮяРэAIЯЕЭГжаФЧаЉЮоЩљЮоЯЂЕФжТУќДэЮѓ

STATE16баОПдКетЦЊзлЪіЗЂЯжЃЌЮяРэAIЯЕЭГДцдк"ОВФЌЪЇаЇ"ЗчЯеЁЊЁЊAIвдИпЖШздаХжДааЛљгкДэЮѓЪРНчаХЯЂЕФЖЏзїЃЌШДВЛДЅЗЂШЮКЮБЈОЏЃЌВЂЬсГідкAIЪфГігыЮяРэжДаажЎМфНЈСЂЖРСЂЪкШЈВуЕФПђМмЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

БОЦкЁЖQuick ChargeЁЗВЅПЭКИЧЖрИіШШЕуЛАЬтЃКЬиЫЙРвЩЫЦЪдЭМЩОГ§FSDЦлеЉЯрЙижЄОнвдЙцБмОоЖюХтИЖЃЛПЈЬиБЫРеГжајЭЦНјНЈжўСьгђЕчЦјЛЏВМОжЃЛзЁеЌЬЋбєФм30%ЫАЪеЕжУтМДНЋЕНЦкЁЃДЫЭтЃЌМЮБіTom PachecoОЭИпбЙЯЕЭГгыЕчГиММЪѕХрбЕеЙПЊЬНЬжЃЌЧПЕїЕчЖЏГЕММЪѕШЫВХХрбјЕФНєЦШадЁЃНкФПЭЌЪБЬсабгавтАВзАЬЋбєФмЕФгУЛЇОЁПьааЖЏЃЌПЩЭЈЙ§EnergySageЦНЬЈБШНЯЖрМвАВзАЩЬБЈМлЁЃ

ЕБAIбЇЛсЁАБпИЩБпбЇЁАЃКUIUCгыЮЂШэСЊКЯДђдьЕФЭјвГжЧФмЬхбЕСЗаТЗЖЪН

UIUCгыЮЂШэСЊКЯбаЗЂЕФOpenWebRLПђМмШУ4BаЁФЃаЭНіЦО400ЬѕГѕЪМЪ§ОнЃЌЭЈЙ§дкецЪЕЭјеОЩЯБпзіБпбЇЕФЧПЛЏбЇЯАЗНЪНЃЌдкЭјвГжЧФмЬхЛљзМЩЯГЌдНСЫгУ27ЭђЬѕЪ§ОнбЕСЗЕФОКељЖдЪжЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

жЧФмЬхЭјТчСїСПЪзГЌецШЫЗУЮЪЃЌ"ЫРЭіЛЅСЊЭј"РэТлв§ЗЂаТељвщ

Mentium Technologies Luna-R1 AIаОЦЌШыбЁET-01аЧзљШЮЮёЃЌЭъГЩЖраЧВПЪ№РяГЬБЎ

ЬРЕРЩњЁСвІЫГгъЃКЬкбЖAIЯТАыГЁЃЌЦДЕФЪЧЁАФЃаЭЁСВњЦЗЁБЯЕЭГФмСІ

AIЧ§ЖЏЭјТчЗИзяЪ§СПьЩ§ЃЌРеЫїШэМўЪмКІепФъді389%ЃКFortinet ЗЂВМ2026ФъШЋЧђЭўаВЬЌЪЦбаОПБЈИц

InboltНЋдкAutomateеЙЛсЗЂВМЪгОѕЧ§ЖЏЛњЦїШЫБрГЬаТЙІФм

БЪМЧБОЕчФдЩюЖШЧхНржИФЯЃКФкЭтМцаоЛРШЛвЛаТ

МгРћИЃФсбЧжнГЧЪаЭЈЙ§ШЋУРЪзИігЩбЁУёЭЖЦБОіЖЈЕФЪ§ОнжааФНћСю

ВёгЭЬцДњЗНАИЃКAIЪ§ОнжааФШчКЮРћгУШМЦјв§ЧцгыеєЦћЮаТжЙЉЕч

AIЖЈвхЦћГЕЪБДњЃЌГЕдивдЬЋЭјПЩППадУцСйШЋаТЬєеН

АВШЋЫуЗЈЕФГжајИќаТе§БфЕУгњЗЂРЇФб

ЙьЕРЪ§ОнжааФБОжЪЩЯЪЧЙІФмЧПЛЏЕФЮРаЧ

ГЩБОДђЕН6ЭђвдЯТЃЌЪжАбЪжНЬФугУ4ТЗШёьХЯдПЈ+жСЧПWХмDeepSeek

ЬьвэдЦCPUЪЕР§ВПЪ№DeepSeek-R1ФЃаЭзюМбЪЕМљ

MWC 2025ЃКгЂЬиЖћеЙЪОЛљгкжСЧП6ДІРэЦїЕФЛљДЁЭјТчЩшЪЉ

гЂЬиЖћжСЧП6аТЦЗЗЂВМЃЌФмЮЊЪ§ОнжааФДјРДФФаЉИФБфЃП

гЂЬиЖћЭЦГіОпБИИпадФмКЭФмаЇЕФвдЬЋЭјНтОіЗНАИ

гЂЬиЖћЭЦГіДюдижСЧП6ДІРэЦїЕФзПдНAIКЭЭјТчНтОіЗНАИ

HPE Gen12ЃКгЂЬиЖћжСЧП6МгГжЃЌЪ§ОнжааФКЭБпдЕМЦЫуЕФЁАаТГшЁБ

гЂЬиЖћGaudi 2D AIМгЫйЦїЮЊDeepSeek Janus ProФЃаЭЬсЙЉМгЫй

гЂЬиЖћЃКЦьЯТЕФЁАжїДђЁБ18A ВњЦЗНЋгк2025 ФъЯТАыФъЭЖВњ

гЂЬиЖћжСЧП6МгГжЯТЕФЛ№ЩНв§ЧцЃЌвЊНЕЕЭДѓФЃаЭЕФгІгУУХМї